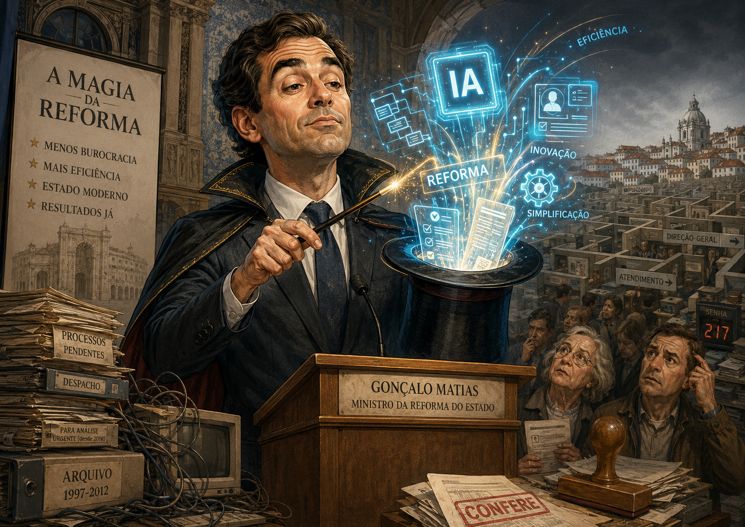

O Estado Agente ou a Velha Burocracia com Cartola Digital

BOX DE FACTOS

- O ministro Gonçalo Matias defendeu a transformação de Portugal num Agentic State, com sistemas de IA capazes de actuar autonomamente em processos públicos.

- Foram apontados como exemplos o licenciamento da construção, a contratação pública e o cruzamento automático de normas, restrições e indicadores.

- A ideia aproxima-se de tendências internacionais, mas exige interoperabilidade, dados fiáveis, supervisão humana, auditoria independente e responsabilidade política.

- Sem reforma institucional séria, a IA pode apenas acelerar a burocracia existente, transformando o erro administrativo em erro automático.

- A União Europeia, a OCDE e o Conselho da Europa sublinham princípios como transparência, responsabilidade, segurança, direitos fundamentais e controlo democrático.

O Estado Agente ou a Velha Burocracia com Cartola Digital

Portugal descobriu agora, com pompa ministerial e brilho de congresso tecnológico, a expressão Agentic State. Segundo foi noticiado pela Lusa e pelo Expresso, o ministro-Adjunto e da Reforma do Estado, Gonçalo Matias, afirmou querer transformar Portugal num Estado capaz de usar sistemas de inteligência artificial para actuar autonomamente, cruzar informação, verificar conformidades, acelerar licenciamentos e acompanhar processos de contratação pública.

A formulação é sedutora. O cidadão apresenta um projecto, indica o terreno, submete as características da obra, e o Estado — esse velho minotauro de carimbos, certidões, guichés e silêncios administrativos — faria o resto em segundo plano. Verificaria planos de ordenamento, restrições ambientais, património, regras de segurança, normas técnicas e eventuais desconformidades. O que hoje demora meses poderia, em teoria, demorar dias.

Em teoria, é belo. Em Portugal, é preciso verificar primeiro se o ficheiro foi carregado em PDF/A, se o formulário aceita cedilhas, se o portal está aberto entre as 09h00 e as 17h00, e se o algoritmo não foi adjudicado numa contratação pública que, por mera coincidência cósmica, acabou sempre no mesmo fornecedor.

A ideia é boa. O problema é o Estado onde ela aterra.

Convém começar pelo essencial: a proposta não deve ser rejeitada por reflexo. Um Estado capaz de usar inteligência artificial de forma responsável poderia reduzir redundâncias, detectar erros, acelerar decisões, evitar pedidos repetidos de documentos que já existem na Administração Pública e permitir ao cidadão tratar da sua vida sem ter de decifrar a máquina pública.

A própria agenda internacional do Agentic State apresenta a IA agente como uma oportunidade para melhorar serviços, acelerar decisões e tornar instituições mais responsáveis, desde que orientada pelo interesse público. A Estónia, tantas vezes citada como exemplo, construiu primeiro uma arquitectura digital coerente, assente em identidade digital, interoperabilidade, assinatura electrónica, cultura de dados e confiança institucional. Só depois passou a explorar camadas mais avançadas de automação e agentes digitais.

A Ucrânia, através do ecossistema Diia, também avançou na digitalização de serviços públicos, usando o digital como instrumento de resistência, simplificação e proximidade entre Estado e cidadão. Os Emirados Árabes Unidos anunciaram igualmente planos muito ambiciosos para integrar IA agente em larga escala nas operações do governo. Mas estes exemplos não devem ser copiados como quem importa mobiliário de catálogo. Têm contextos institucionais, jurídicos, culturais e políticos muito diferentes.

O perigo português é outro: querer saltar directamente para a inteligência artificial sem resolver a inteligência administrativa. Antes de pôr agentes autónomos a decidir, é preciso perguntar se os dados estão limpos, se os sistemas comunicam, se as leis são coerentes, se os processos estão mapeados, se há responsáveis identificáveis e se o cidadão terá direito real a contestar uma decisão automatizada.

A IA não reforma processos podres. Apenas os acelera.

Há uma ilusão muito comum entre decisores políticos fascinados por tecnologia: a ideia de que um sistema informático sofisticado resolve automaticamente problemas organizacionais antigos. Não resolve. Uma má lei digitalizada continua a ser uma má lei. Um processo absurdo automatizado continua a ser absurdo. Uma base de dados errada, quando ligada a IA, não se torna sábia: torna-se perigosamente convincente.

A Administração Pública portuguesa sofre há décadas de fragmentação institucional, sobreposição de competências, medo de decidir, cultura defensiva, excesso de formalismo, fraca responsabilização e pouca avaliação real de desempenho. Se esta estrutura for apenas coberta por uma camada de agentes inteligentes, o resultado poderá ser uma burocracia mais veloz, mas não necessariamente mais justa, mais transparente ou mais humana.

A expressão Estado em acção soa bem. Mas importa perguntar: em acção para quê? Para servir melhor o cidadão ou para blindar decisões? Para simplificar a vida das pessoas ou para criar uma nova caixa negra administrativa? Para combater a corrupção e o desperdício ou para entregar a governação pública a plataformas opacas, fornecedores privados e modelos que ninguém consegue auditar?

O fantasma da caixa negra

A experiência internacional recomenda prudência. A Amnistia Internacional denunciou o caso neerlandês dos apoios à infância, em que sistemas algorítmicos usados pelas autoridades fiscais contribuíram para perfis de risco discriminatórios e falsas acusações de fraude contra milhares de famílias. O caso tornou-se um aviso severo sobre o uso de algoritmos no Estado sem transparência, controlo e garantias de direitos.

O relator especial das Nações Unidas sobre pobreza extrema e direitos humanos também saudou, em 2020, a decisão de um tribunal neerlandês que travou o sistema SyRI, uma ferramenta digital de detecção de fraude social, por violação de normas de direitos humanos. Estes episódios mostram uma verdade desconfortável: quando o Estado automatiza suspeitas, os cidadãos mais frágeis costumam ser os primeiros a pagar a factura.

Em Portugal, onde muitos cidadãos já se sentem esmagados por portais confusos, balcões contraditórios e decisões sem rosto, a introdução de agentes de IA exige garantias reforçadas. O cidadão não pode passar de vítima do funcionário sem tempo para vítima do algoritmo sem rosto. A modernização do Estado não pode transformar o direito ao contraditório numa mensagem automática: "A sua reclamação foi recebida. Tempo médio de resposta: eternidade."

Contratação pública: onde a IA pode ajudar — e onde pode ser capturada

A contratação pública é um dos domínios onde a IA poderia ter enorme utilidade. Agentes inteligentes poderiam comparar preços de mercado, detectar padrões de concentração de fornecedores, alertar para propostas anormalmente caras, identificar cláusulas restritivas, acompanhar execução contratual, verificar derrapagens orçamentais e produzir trilhos de auditoria.

Mas também aqui mora o diabo — e em Portugal o diabo costuma conhecer bem os corredores. Quem treina os modelos? Que dados são usados? Quem define os critérios de risco? Que empresas fornecem as plataformas? Os modelos serão auditáveis? Os relatórios serão públicos? O Tribunal de Contas terá capacidade técnica para fiscalizar sistemas algorítmicos? A Assembleia da República saberá escrutinar contratos tecnológicos complexos?

Sem estas respostas, a IA na contratação pública pode deixar de ser um instrumento contra o sobrepreço e transformar-se numa máquina sofisticada para legitimar más decisões. O algoritmo dirá que está tudo conforme. O fornecedor agradecerá. O contribuinte pagará. E, como sempre, surgirá alguém a explicar que a culpa foi de uma "anomalia no sistema".

O enquadramento europeu não é decorativo

O Regulamento Europeu da Inteligência Artificial entrou em vigor em 2024 e estabelece uma abordagem baseada no risco. Sistemas usados em áreas sensíveis, com impacto em direitos, serviços essenciais, acesso a oportunidades, fiscalização ou decisões públicas, podem ser classificados como de alto risco e sujeitos a obrigações exigentes.

O Conselho da Europa, por sua vez, aprovou a Convenção-Quadro sobre Inteligência Artificial, Direitos Humanos, Democracia e Estado de Direito, o primeiro tratado internacional juridicamente vinculativo nesta matéria. A OCDE também tem insistido em princípios como responsabilidade, transparência, robustez, segurança, respeito pelos direitos humanos e valores democráticos.

Isto significa que o Estado português não pode lançar agentes autónomos como quem instala uma nova versão de software. Terá de demonstrar conformidade, segurança, proporcionalidade, supervisão humana, mecanismos de recurso, gestão de risco, protecção de dados e responsabilização efectiva.

A pergunta decisiva: quem responde pelo erro?

Num Estado democrático, uma decisão administrativa tem de ter autor, fundamento, possibilidade de impugnação e responsabilidade. Se um agente de IA recusar uma licença, atrasar um processo, sinalizar uma empresa, bloquear um apoio ou indicar risco de fraude, quem responde?

Responde o programador? O fornecedor? O organismo público? O dirigente? O ministro? O modelo? O "sistema"? Ou entraremos na velha dança portuguesa da irresponsabilidade circular, em que todos participaram, ninguém decidiu, ninguém sabia, ninguém podia prever, e no fim o cidadão que apresente reclamação por via electrónica?

Esta é a questão central. Um Estado agente sem responsabilidade humana identificável não é modernização. É desmaterialização da culpa.

O que Portugal deveria fazer antes de invocar a magia

Antes de anunciar um Estado autónomo, Portugal deveria cumprir um roteiro mínimo de decência técnica e democrática:

- Inventariar todos os processos administrativos críticos antes de os automatizar.

- Eliminar etapas inúteis, documentos redundantes e exigências contraditórias.

- Criar uma arquitectura nacional de interoperabilidade verdadeiramente operacional.

- Publicar registos públicos dos sistemas algorítmicos usados pelo Estado.

- Exigir auditorias independentes antes e depois da entrada em produção.

- Garantir explicabilidade das decisões que afectem cidadãos e empresas.

- Assegurar sempre revisão humana qualificada em decisões sensíveis.

- Definir responsabilidade política, administrativa e técnica por erros dos sistemas.

- Proteger os dados dos cidadãos com regras claras de minimização, segurança e finalidade.

- Evitar dependência excessiva de fornecedores únicos ou plataformas fechadas.

Só depois disto fará sentido falar em agentes inteligentes. Caso contrário, estaremos apenas a pôr asas digitais num animal administrativo que ainda não aprendeu a andar direito.

Conclusão: menos magia, mais Estado sério

O Estado português precisa, sem dúvida, de uma revolução digital profunda. Precisa de usar IA, automatizar tarefas, cruzar dados, reduzir tempos de espera, combater desperdício, tornar processos transparentes e libertar cidadãos e empresas da sua ancestral via-sacra burocrática.

Mas não precisa de ilusionismo tecnológico. Precisa de arquitectura, ética, competência, responsabilidade e coragem para mexer nos interesses instalados. Precisa de dirigentes que compreendam tecnologia e de técnicos que compreendam democracia. Precisa de dados limpos, leis claras, processos simples e instituições auditáveis.

A IA pode ser uma ferramenta magnífica. Pode ajudar a cortar a selva administrativa que sufoca o país. Mas uma ferramenta não substitui carácter institucional. E nenhum agente artificial compensará a falta de inteligência política, moral e organizacional de um Estado que durante décadas confundiu procedimento com serviço, papelada com rigor e lentidão com prudência.

O verdadeiro milagre não será Portugal tornar-se um Agentic State. O verdadeiro milagre será Portugal tornar-se, antes disso, um Estado competente.

Referências e leituras credíveis

- Expresso / Lusa — Ministro da Reforma do Estado quer transformar Portugal num "Agentic State"

- Diário de Notícias da Madeira / Lusa — Síntese da intervenção de Gonçalo Matias

- APDC — Agenda do 35.º Digital Business Congress

- Governo de Portugal — Reestruturação da APA e ICNF, simplificação e recurso a IA

- The Agentic State — Plataforma internacional sobre IA agente no sector público

- Banco Mundial — Artificial Intelligence in the Public Sector

- Comissão Europeia — Regulamento Europeu da Inteligência Artificial

- Conselho da Europa — Convenção-Quadro sobre IA, Direitos Humanos, Democracia e Estado de Direito

- OCDE — Princípios para uma IA fiável

- OCDE — Responsabilização algorítmica no sector público

- e-Estonia — Identidade digital e agentes de IA no Estado

- UAE Media Office — Plano dos Emirados Árabes Unidos para IA agente no governo

- Amnistia Internacional — Escândalo neerlandês dos apoios à infância e algoritmos discriminatórios

- Nações Unidas / OHCHR — Decisão judicial neerlandesa contra sistema digital de detecção de fraude social

Fragmentos do Caos

Crónica crítica de Francisco Gonçalves, com apoio editorial de Augustus Veritas.

Nota Editorial

A modernização do Estado português através da inteligência artificial não deve ser recusada por preconceito tecnológico. Pelo contrário: um Estado mais rápido, mais transparente, mais interoperável e menos cruel na sua relação com o cidadão é uma necessidade urgente. A inteligência artificial pode ajudar a cortar redundâncias, detectar erros, acelerar processos e libertar pessoas e empresas de uma burocracia que demasiadas vezes parece existir para se justificar a si própria.

Mas a tecnologia não é uma absolvição moral. Um Estado incompetente não se torna sábio por instalar algoritmos. Uma Administração Pública confusa não se torna inteligente por adoptar agentes autónomos. Uma má decisão automatizada continua a ser uma má decisão — apenas chega mais depressa, com aparência técnica e menor rosto humano.

O chamado Agentic State só fará sentido se vier acompanhado de responsabilidade política, auditoria independente, transparência, protecção de dados, revisão humana e direito efectivo ao contraditório. Sem estes pilares, a inteligência artificial no Estado poderá transformar-se numa nova forma de opacidade: uma burocracia invisível, veloz, implacável e sem culpados identificáveis.

Portugal precisa, sem dúvida, de inteligência artificial no sector público. Mas precisa ainda mais de inteligência institucional, ética administrativa e coragem reformadora. Antes de desejar um Estado agente, talvez devêssemos ambicionar algo mais simples e mais revolucionário: um Estado competente, honesto, compreensível e ao serviço dos cidadãos.

A tecnologia pode ser uma lâmina magnífica. Mas uma lâmina nas mãos erradas não faz cirurgia: apenas corta mais fundo.